在当前科技迅猛发展的背景下,人工智能(AI)与视觉处理技术的融合为诸多领域带来了**的变革。

特别是AI视觉助手(该系统旨在通过实时场景理解和多模态交互,提供对视觉环境的深刻理解和即时反馈,特别适用于辅助视力障碍和沟通障碍患者。),已经在多个应用场景中展示了其**的潜力与应用前景。

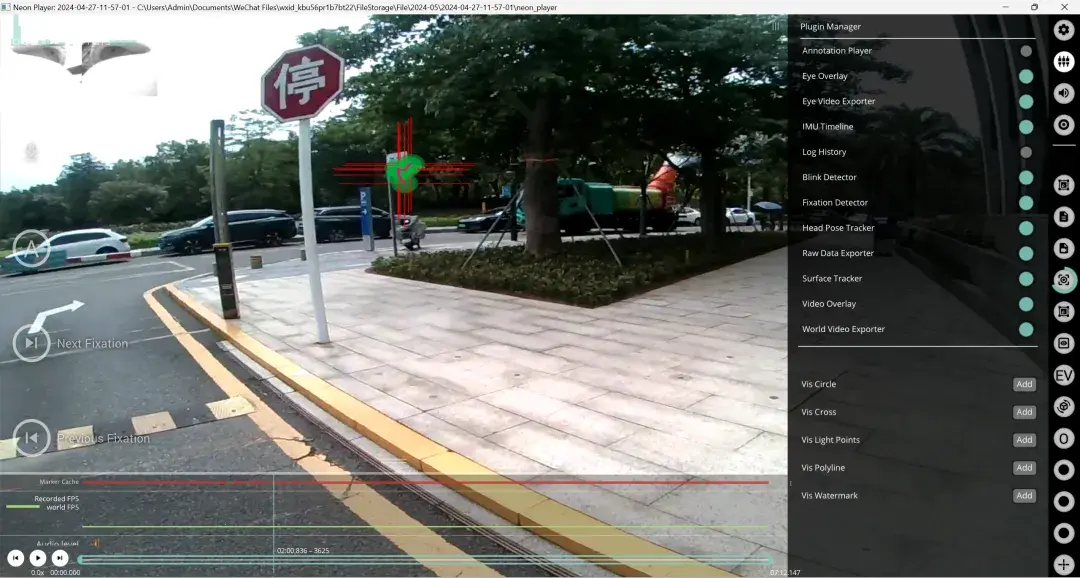

本文将分享如何利用Neon与OpenAI的GPT-4V构建一个强大的AI视觉助手。

01 多模态人工智能模型

GPT-4V是OpenAI推出的**多模态模型,具备理解和处理图像、文本的能力。这种模型不仅可以进行传统的自然语言处理,还能对输入的图像进行分析和解释。其**优势在于:

Pupil Neon是一款高精度的眼动仪设备,用于实时采集用户的眼动数据和注视点信息。其**优势包括:

在构建AI视觉助手时,实时场景理解和响应是关键。系统通过Pupil Neon采集用户的眼动数据和注视点信息。

将这些数据通过网络传输至服务器,用户从实时视频流中按下特定的按键(如Space键)抓取一帧并将其发送到GPT-4V进行处理。

接着,GPT-4V能够识别并描述用户正在注视的物体,或解释场景中的内容。

为了满足不同场景下的需求,系统定义了四种响应模式,用户可以通过按键(如“ASDF”键)进行切换:

1. A模式:描述注视物体

对用户正在注视的物体进行详细描述。

2. S模式:检测潜在危险

识别用户周围的潜在危险并及时提醒。

3. D模式:猜测用户意图

根据用户的注视和上下文,猜测用户的意图并提供相应建议。

4. F模式:详细环境描述

提供更详细的环境描述,包括周围物体和整体布局。

Neon将GPT-4V生成的文本转化为语音,通过虚拟人形象与用户进行互动。这种多模态交互不仅提升了用户体验,也使系统响应更具人性化和自然感。例如,当用户注视某个物体并按下按键时,Neon可以实时描述该物体的特征或提供相关信息。

为了评估系统的有效性和实用性,研究人员进行了多轮实验。

实验场景包括日常生活环境和特殊辅助场景(如视力障碍辅助和沟通障碍辅助)。

参与者包括健康个体和具有特定需求的用户,系统通过摄像头实时捕捉视线焦点并生成相应的语音反馈。

初步实验结果显示,GPT-4V在识别和描述图像内容方面表现出色,能够准确识别大多数物体和场景。

Neon的语音反馈也被参与者认为自然且有帮助。

然而,由于网络延迟,系统在处理即时危险检测时存在一定滞后。未来的改进方向包括优化模型在本地运行,以减少延迟并提高响应速度。

AI视觉助手可以**提升视力障碍用户的生活质量。通过物体识别与描述功能,用户能够获取周围环境的信息,增强**生活能力。例如,当用户注视到某物体时,系统可以描述其外观和功能,帮助用户更好地理解周围环境。

对于患有ALS等沟通障碍的患者,AI视觉助手提供了一种有效的交流手段。用户通过注视选择不同的选项或指令,系统识别用户意图并进行相应的语音反馈。这种交互方式不仅提升了患者的沟通能力,也增强了他们的生活自信。