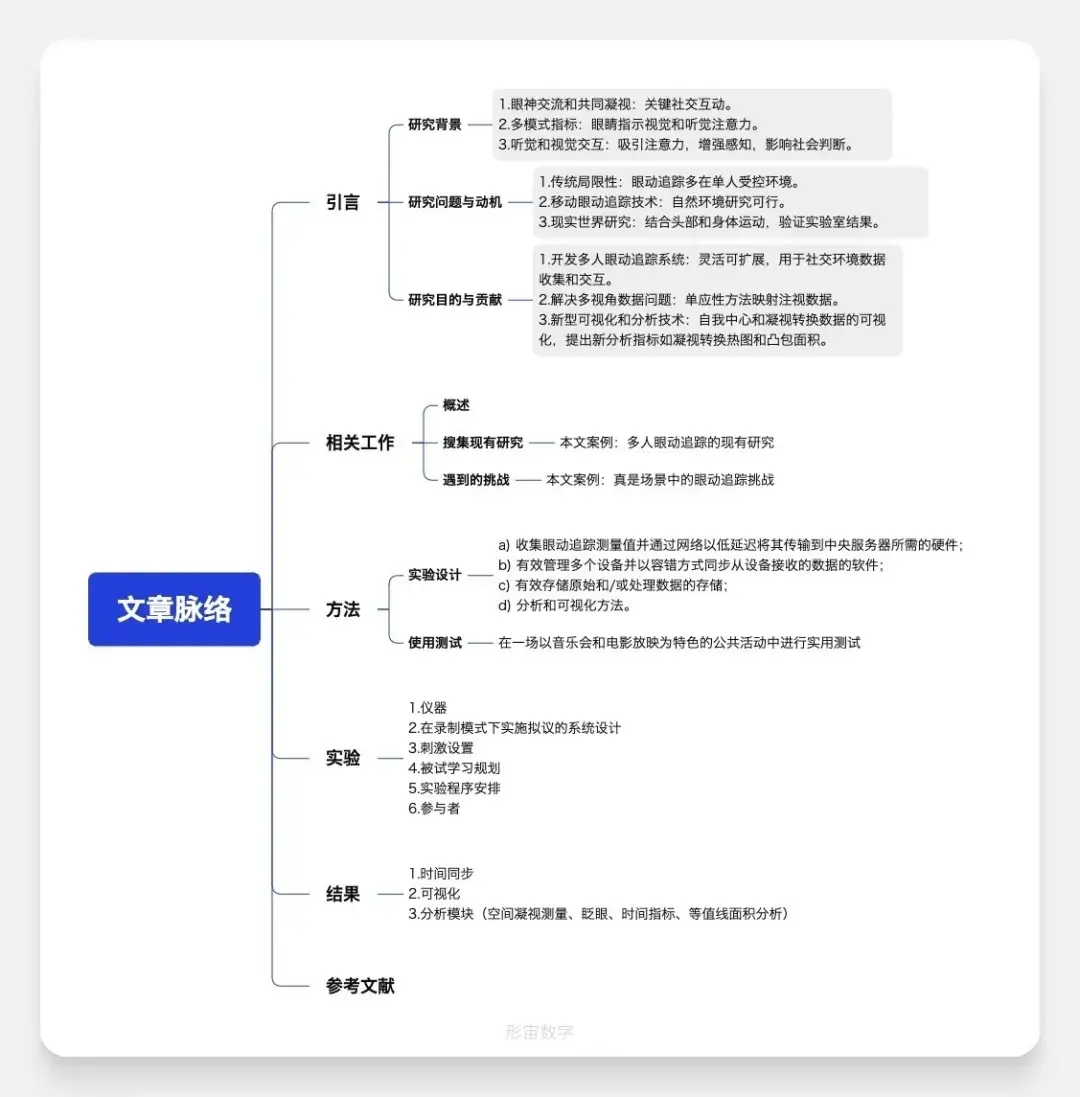

在现代社会的喧嚣中,我们常常被淹没在无数的信息洪流中。然而,有一种微妙而无声的交流形式,它通过我们不经意间的目光,悄然揭示了内心深处的秘密。这便是眼球的运动,一扇通往心灵深处的窗户。

当你与朋友们共同观赏一场音乐会或电影时,你们的目光交汇,注意力随着精彩的演出而起伏,这些微妙的眼球运动描绘出了一幅集体注意力的动态画卷。然而,传统的眼球追踪研究多在单人且受控的实验室环境中进行,缺乏对多人自然场景的验证,难以捕捉这种丰富的社交互动。

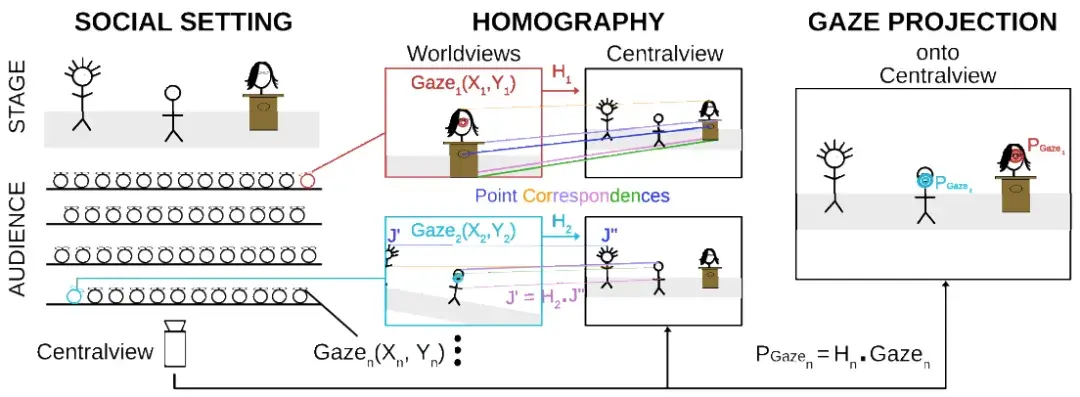

左图:共享场景示意图,描绘了多个佩戴移动眼动追踪眼镜的人注视舞台。观众席后面的中央摄像头记录了共享场景(中央视图)。

中图:每个戴眼镜的人的自我中心场景视角需要投射到中央视图上。自我中心和中央视图之间的点对应关系用于计算关联这两个视图的单应性矩阵。

右图:使用计算出的单应性矩阵重新映射凝视坐标,所有人的凝视都可以投射到共享场景(中央视图)上。

本文将分享一篇来自加拿大的研究,提供在多人自然场景中应用移动眼球追踪技术的新视角,开发了一个传输、记录和分析同步数据的创新系统。

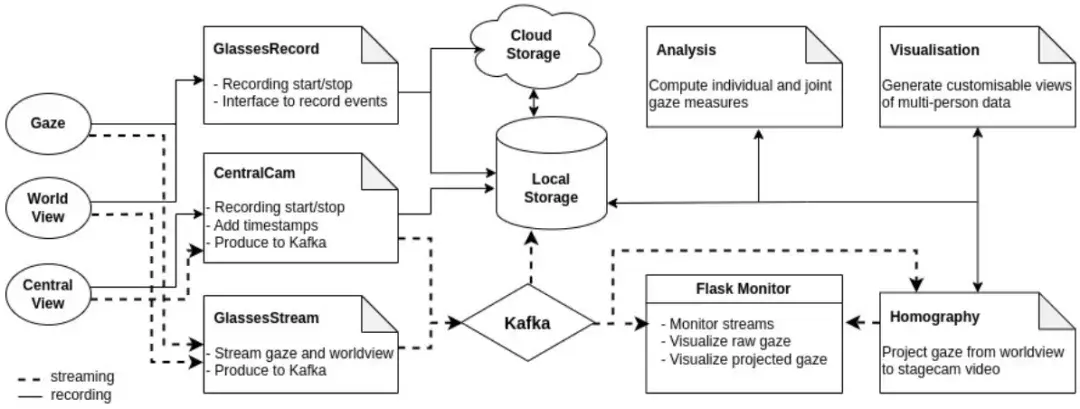

实线和虚线分别表示记录和流式传输操作模式。每种操作模式都使用单独的模块(狗耳矩形)来处理传入的数据。

功能:将记录的场景视角框架、凝视样本和中心视图框架中的带时间戳的数据与中心视图空间中转换后的凝视数据同步,并通过多种可视化技术呈现,用于深入分析。

可视化示例:

1) 单人凝视和场景视角:同步场景视角流的凝视叠加为单独的视频文件,支持叠加每个数据样本的相关时间戳。

2) 多人凝视和场景视角:在自定义大小的2D网格中呈现包含所有选定观众场景视角的单个视频,并带有凝视点叠加。

3) 单人自我中心和变换凝视视图:为单个观看者堆叠时间同步的场景视角和中心视图框架,叠加每个视图上的凝视和变换后的凝视。

4) 中央视图上的多人转换凝视:在中央视图显示所有选定观察者的时间同步凝视坐标,并带有唯一ID和轮廓颜色的自定义圆圈,或者以热图形式显示。

5) 多人自我中心的视角转移到中央视角:结合所有选定观察者的场景视角,将其绘制为网格,并将时间同步的中央视角置于中心单元中,显示所有转换后的视线点。

功能:提供预处理和评估自我中心凝视数据以及单应性变换凝视数据的方法,用于集体凝视分析指标,如下:

1) 平均注视速度:通过欧几里得距离的时间序列计算注视速度,量化注视预测的平均精度。

2) 热图:通过高斯滤波器计算凝视热图,用于显示凝视分布。

3) 热图相似度和相关性:计算热图分布之间的相似度和相关性,量化它们之间的相似程度和线性关系。

4) 静止凝视熵:通过香农熵方程计算凝视坐标的不确定性水平,反映凝视的可预测性。

5) 凸包面积:动态测量凝视分散度随时间的变化,通过计算凝视样本包围的最小凸多边形的面积。

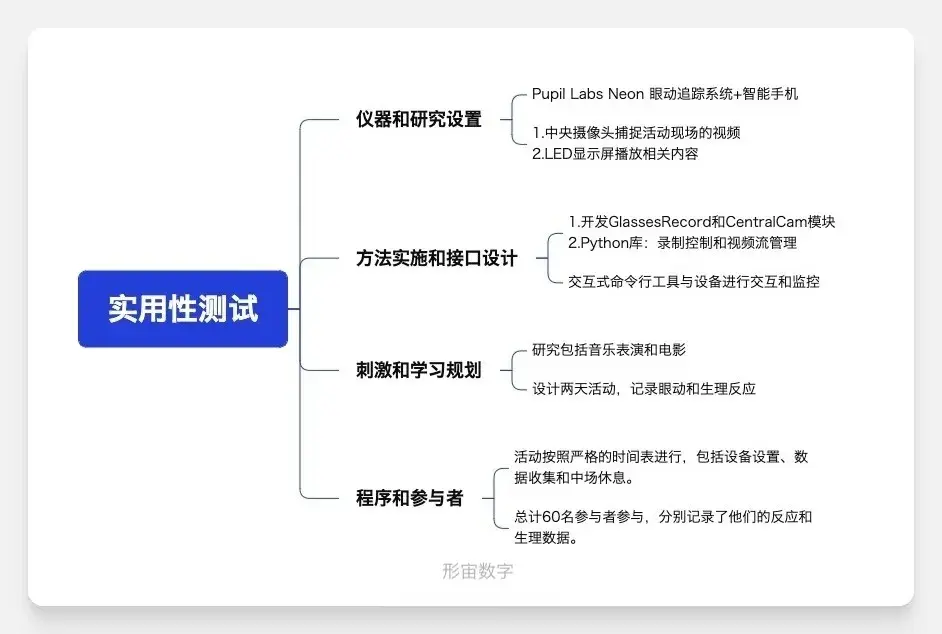

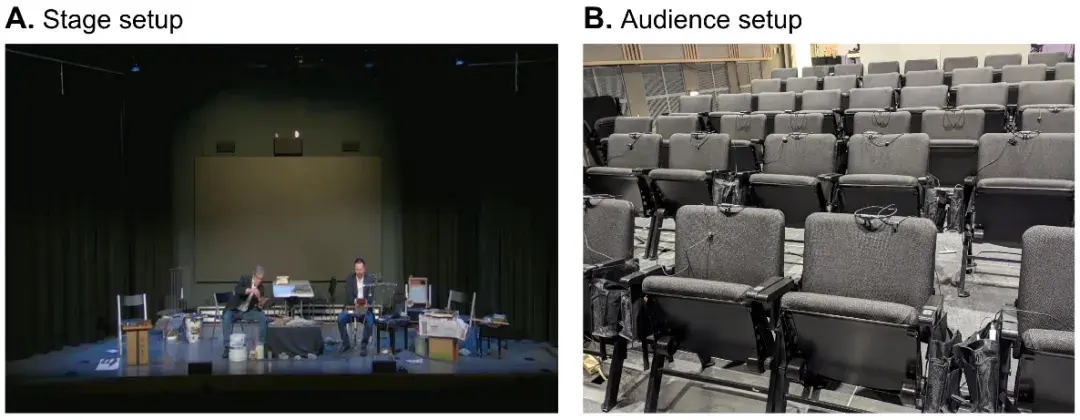

A:活动音乐会部分的舞台设置。电影在表演者身后的视频墙上播放。电影放映期间,舞台被清理和/或覆盖。B:表示观众座椅,每个座位上都附有眼动追踪眼镜。眼动追踪眼镜连接到配套智能手机,这些智能手机固定在每对座椅两侧的口袋中。

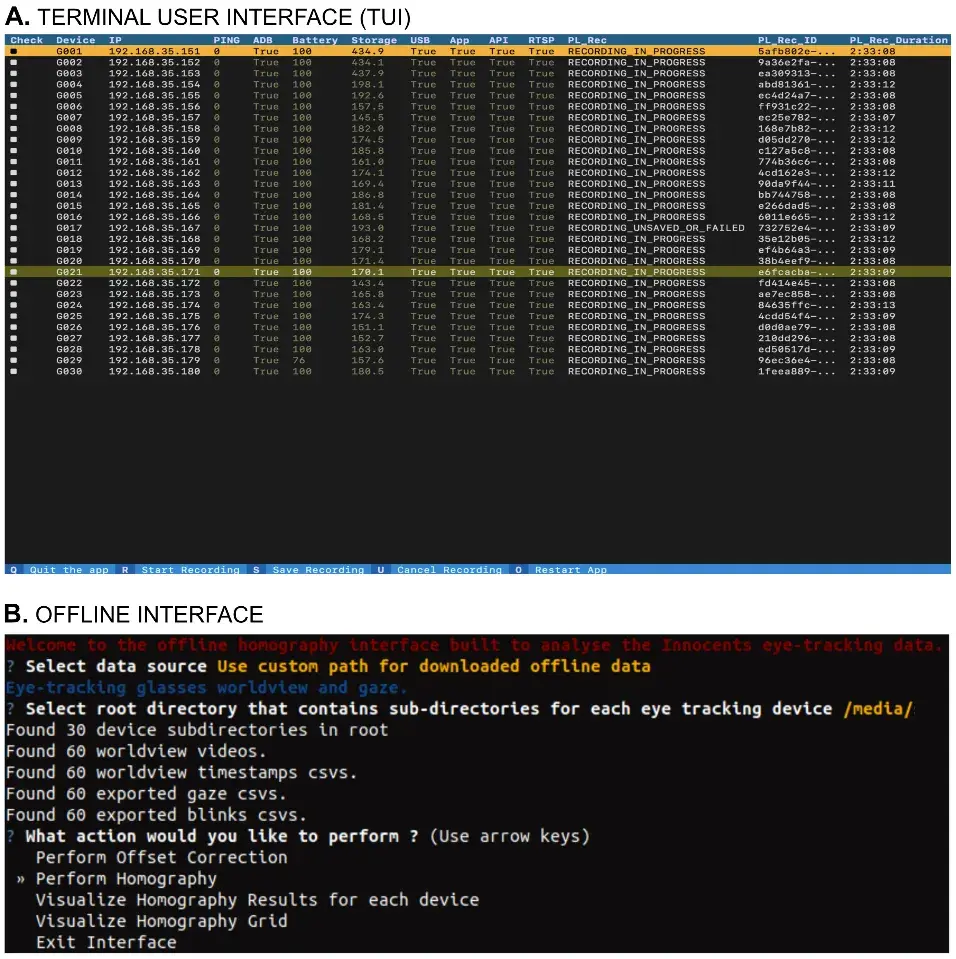

A:GlassesRecord 模块的终端用户界面 (TUI),用于同时监控和操作所有 30 台设备。

B:命令行界面,用于离线分析和可视化记录的数据。

1) 使用 OpenCV 和 FFMPEG 库,从中央摄像头检索 RTSP 流。

2) 使用 H264 编解码器将流压缩到 MPEG4 容器中。

3) 在录制结束之前添加了 600 丢帧的容差,以处理网络上的间歇性数据包丢失。

4) FPS 是在 180 帧的窗口上计算,并存储为 CSV 文件格式。

1) 使用了深度学习模型 SuperGlue 找到稳健的特征点对应关系,用于 Homography 模块。

2) 分析和可视化模块使用 Python 3.12 实现。

3) 使用 Neon 眨眼检测算法过滤掉原始注视数据中的眨眼动作。

1) 使用 Python 的 questionary 库开发,与三个模块交互。

2) 允许选择记录子集来执行操作,如单应性、可视化、注视指标计算,并将结果存储到本地文件系统。

1) 视角转换是通过估算参与者与视频墙的距离完成的。

2) 给出了参与者与视频墙的距离(758、885、1012 cm)和视频墙的物理尺寸(宽度 384.5 cm,高度 216 cm)。

3)根据参与者的视觉记录,估算了视频墙对角线在像素中的表示(515、441、396 px)。

4) 计算出视角与像素的比率约为 16,这意味着在 1600x1200 分辨率下,每个视觉度数由大约 16 个像素表示。

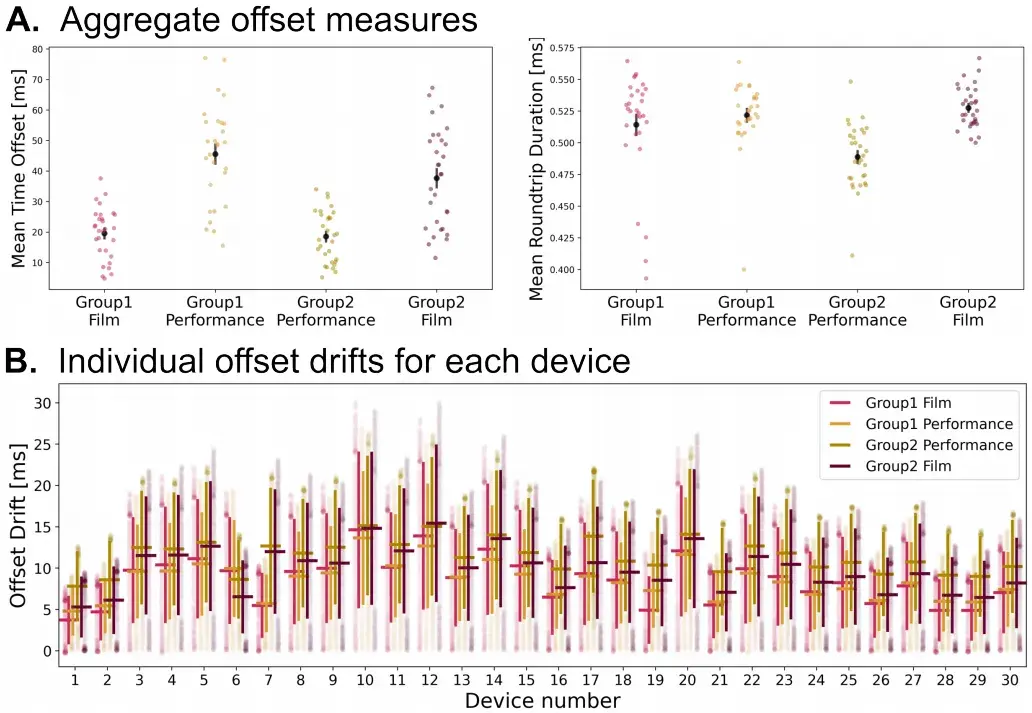

偏移:在四个会话期间,以 10 秒的固定时间间隔记录每个设备与服务器之间的时间偏移和平均往返时长。

漂移:时间偏移的累积漂移被计算为给定时间点的偏移与初始偏移之间的差值。

A:每天两次会话记录的平均时间偏移(左)和平均往返时长(右),单位为毫秒。彩色点表示测量时间点的偏移(约 10 秒间隔);黑点表示平均值,误差线表示标准误差。

B:计算四个会话中每个设备的偏移漂移。垂直条表示标准偏差,水平条表示平均值,单个点表示测量时间点的单个数据点。

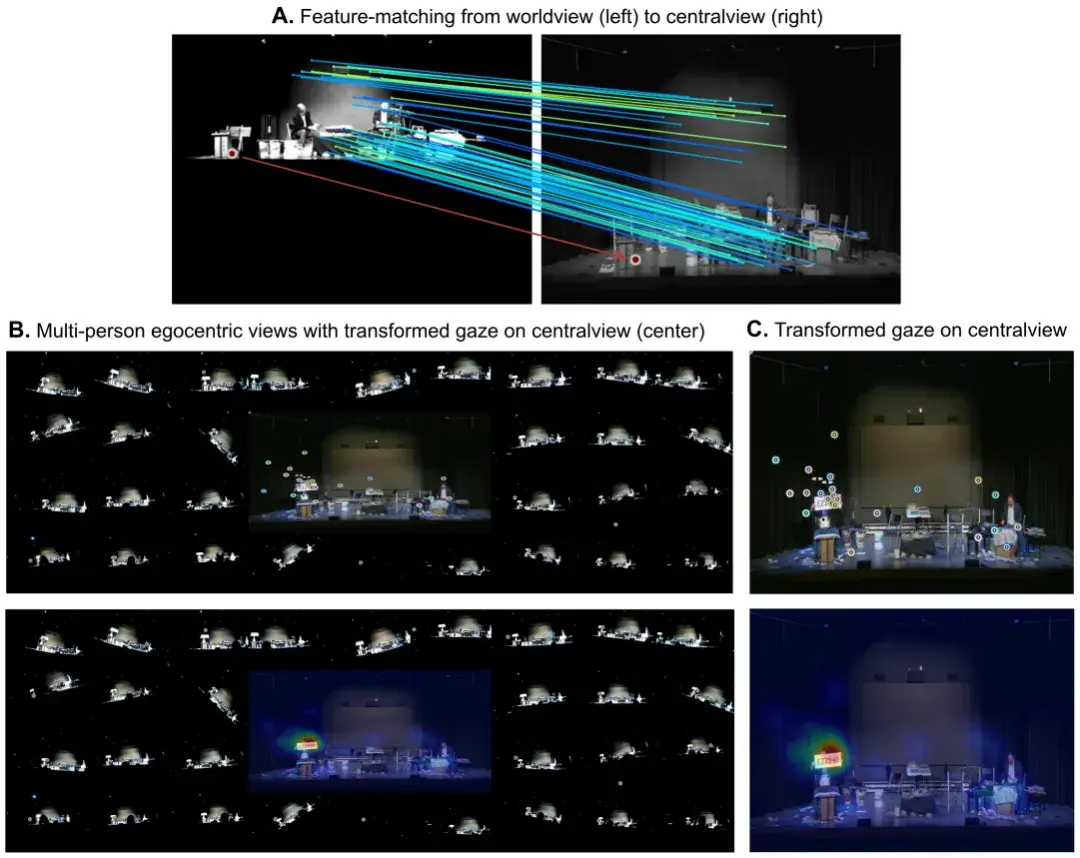

A:从一位参与者的场景视角的一帧(左)到中央视图(右)进行特征匹配的示例。记录的与此帧相对应的凝视用栗色和白色圆圈表示。

B:使用可视化模块生成的多人视图。

顶部:所有参与者的自我中心场景视角和凝视(小白色和黑色圆圈)显示在周边。使用为每个参与者计算的单应性矩阵,我们将每个参与者的凝视投射到中央视图(中心)上。在中心面板中,参与者的凝视用独特颜色的圆圈表示,中间为白色以提高可见性。

底部:与顶部相同,中心网格单元显示所有参与者注视场景的 2D 凝视密度热图。热图中的强度越高(强度从蓝色增加到红色,红色最高)表示注视该位置的参与者比例越高。

C:与 B 中的中心面板相同,但调整了大小以提高可见性。

在去除眨眼数据后,将原始自我中心凝视坐标和单应性变换后的凝视坐标分别投影到每个观看者的场景视角和共享中心观上。

通过可视化(图6)快速检查数据,并展示 SuperGlue 特征识别实现的精确投影变换,处理视频伪影等问题。边缘情况下的投影变换仍需进一步研究。

图6提供静态单帧示例,示例视频展示了目光跟随表演者移动的可靠性。

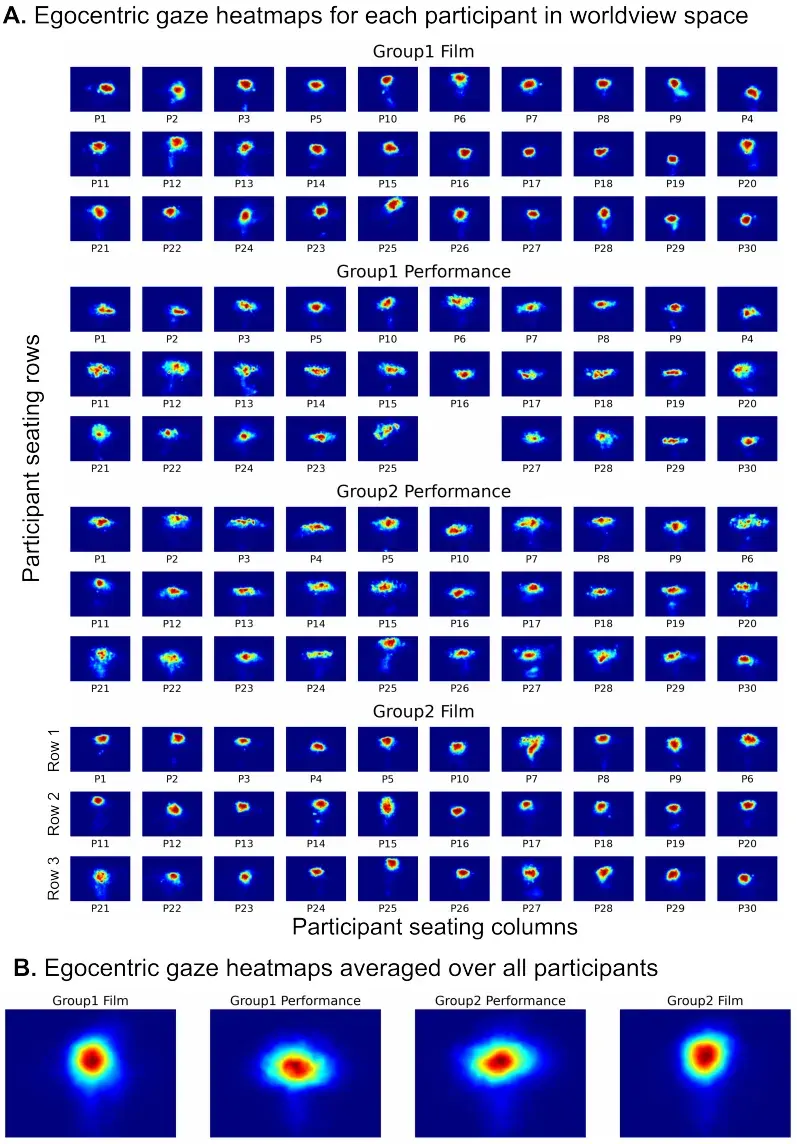

A:四个活动场次的参与者凝视热图。热图按照两天的座位顺序排列,其中顶行(第 1 行)最靠近舞台,第一列(从左侧开始)是最左边的参与者。场次按时间顺序从上到下排列。

B:平均凝视热图,计算为每个场次所有参与者的平均值。

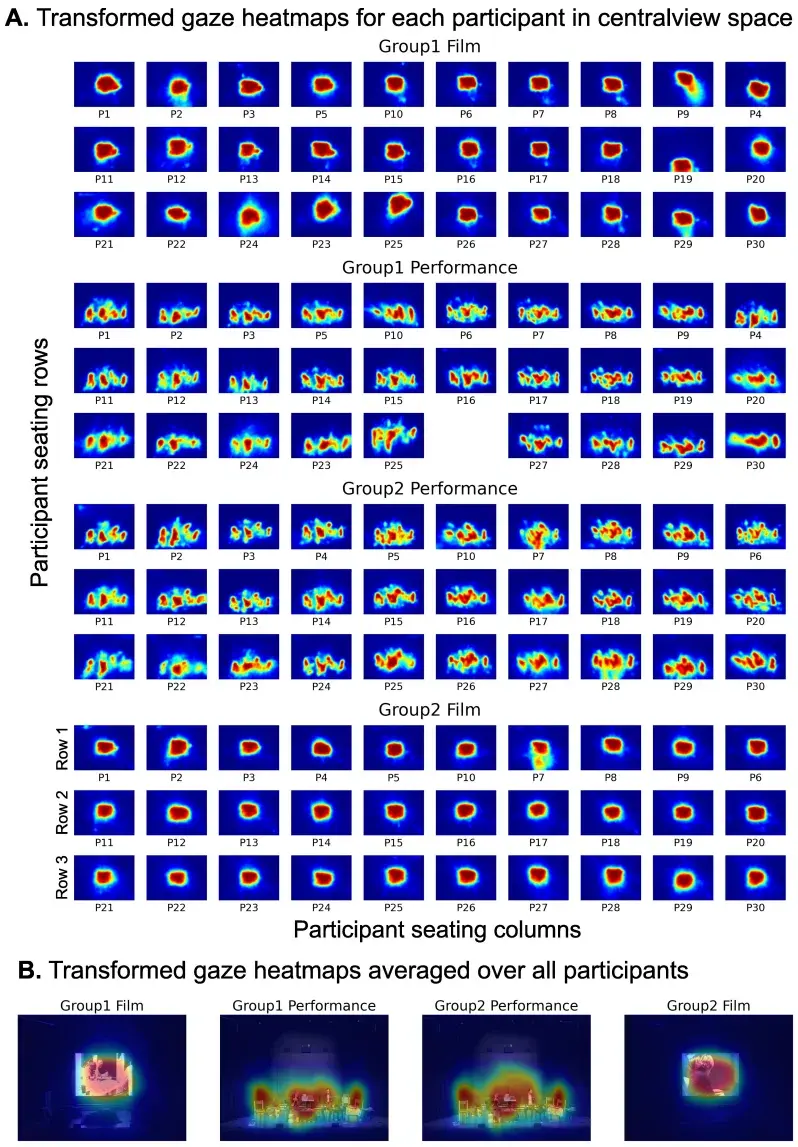

A:每次活动会话的参与者凝视热图。热图按照两天的座位顺序排列,其中顶行(第 1 行)最靠近舞台,第一列(从左侧开始)是最左边的参与者。会话按时间顺序从上到下排列。

B:平均凝视热图,计算为每个会话所有参与者的平均值。

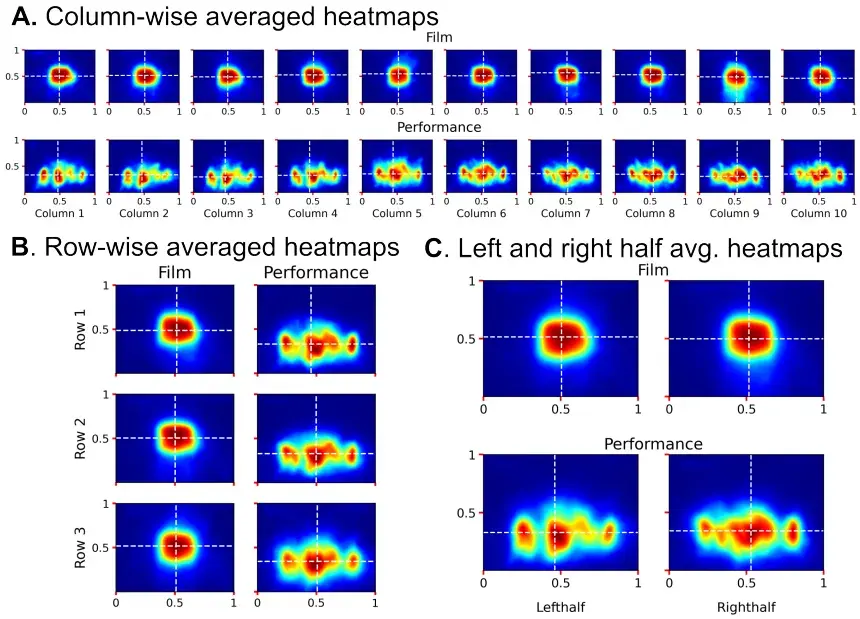

x 和 y 坐标轴的中心分别由底部和左侧轴上的黑色刻度表示。轴已标准化,中心标记为 0.5。白色虚线表示峰值热图强度在相应坐标轴上的位置。

A:显示两天事件中所有行的列平均值。

B:显示两天所有列的行平均值。

C:显示观众左半部分(左列)和右半部分(右列)的热图平均值(分别对 1-5 列和 6-10 列的所有行取平均值)。

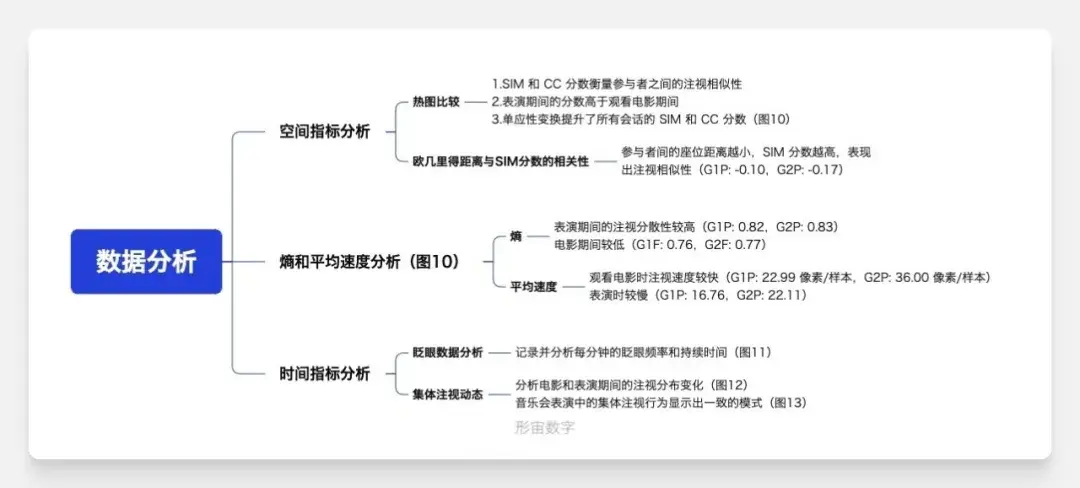

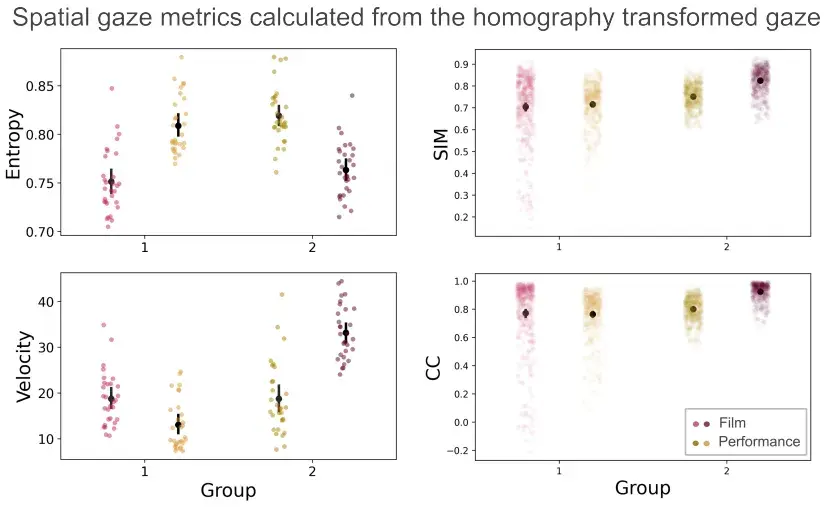

所有图中的黑点代表平均值,误差线代表各自平均值的置信区间。凝视熵和速度衡量了每个参与者的个体凝视变化性,热图相似度 (SIM) 和相关性 (CC) 估计了参与者每次会话中凝视探索的相似性。

两天中两个会话的凝视熵(左上)、平均凝视速度(左下)、成对热图相似度(右上)和成对热图相关性(右下)测量值。

左侧:图中的彩色点表示单个参与者的熵和速度测量值。

右侧:图中的彩色点表示所有唯一参与者对的 SIM 和 CC。

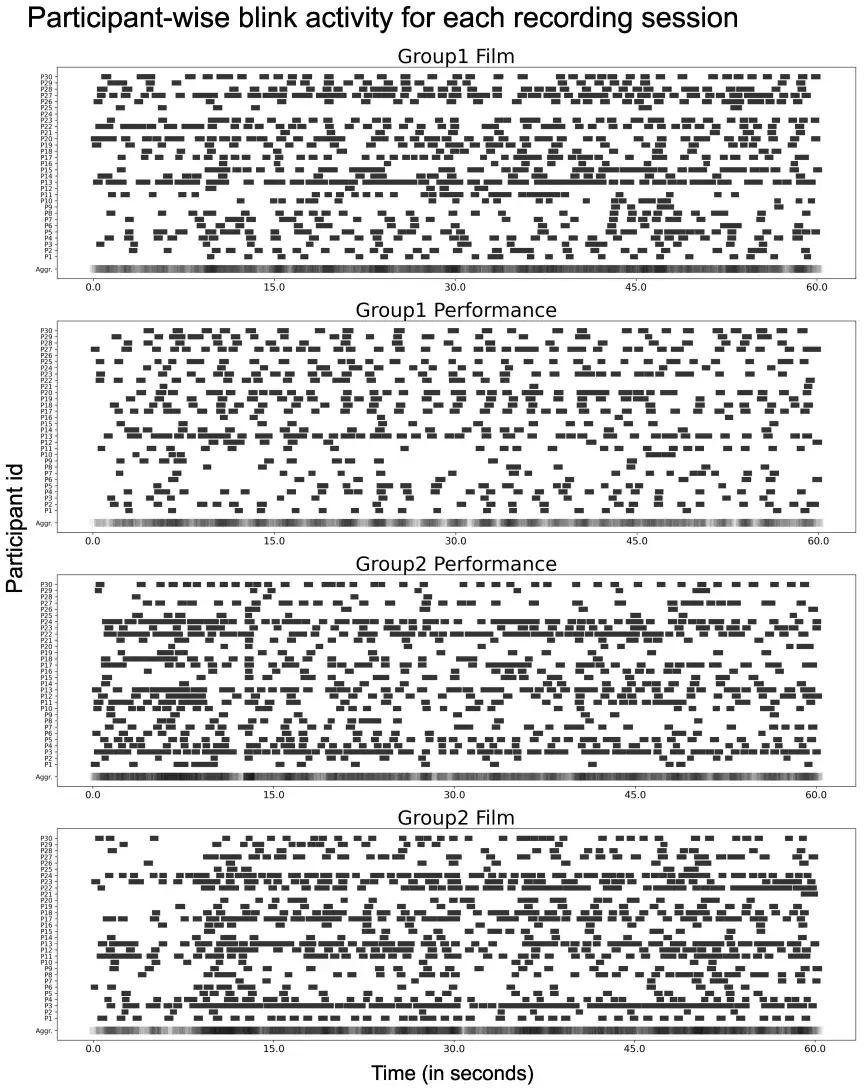

每个水平条代表眨眼的开始和结束,长度代表眨眼持续时间。四个图表的底部一行代表整体眨眼活动随时间变化的单色热图,颜色较深的区域代表眨眼的人较多,颜色较浅的区域代表同一时刻眨眼的人较少。

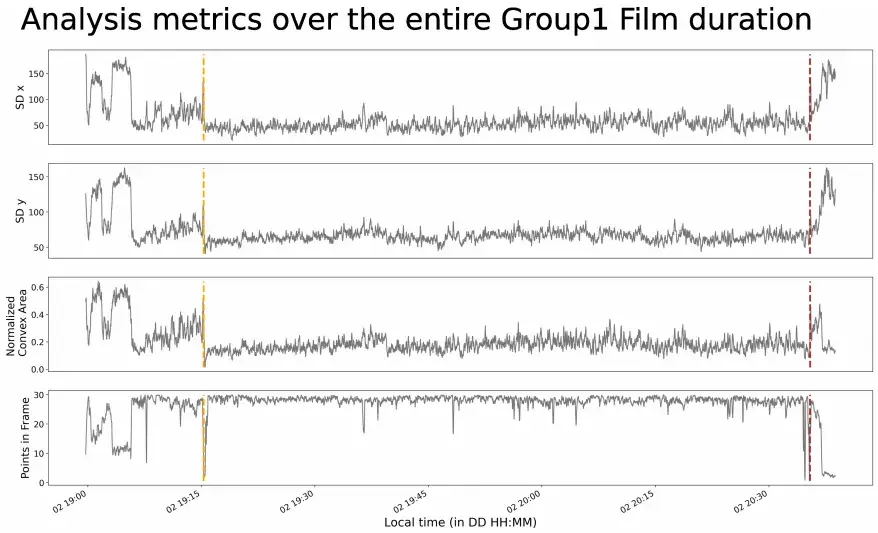

橙色垂直线代表电影的开始;棕色代表结束。

测量值是通过汇总中央视图中每帧的所有 30 名参与者的注视点来计算的。

从上到下,测量值分别是水平方向上点的标准差、垂直方向上的标准差、包围所有点的最小凸包面积以及中央视图帧边界内的点数。

所有时间序列都使用 150 个样本的滚动平均窗口大小进行平滑处理,以过滤高频噪声。

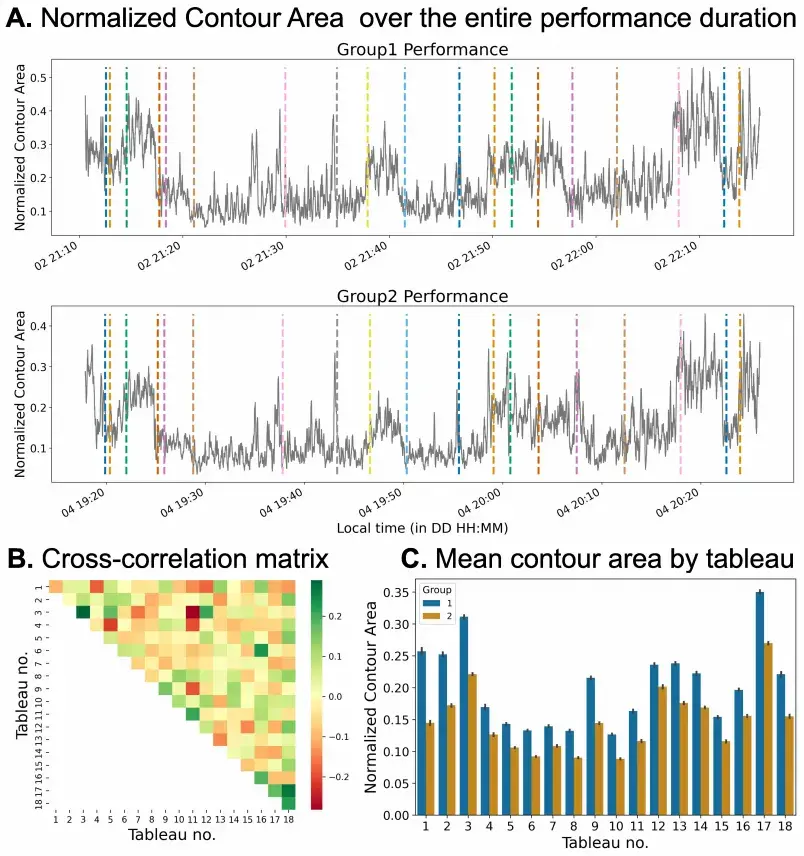

A:两天的音乐会表演期间每个时间点的所有注视点的最小凸包的归一化轮廓面积(G1P:顶部;G2P:底部)。表演由 17 个不同的画面组成;虚线依次表示表演中每个画面的手动注释开始时间,另外的第一条和最后一条线分别表示表演的开始(表演者进入舞台)和结束(最后一幅画面的结束)。颜色与画面编号相对应。所有时间序列都经过平滑处理,滚动平均窗口大小为 150 个样本,以过滤高频噪声以实现可视化。

B:每对画面之间的互相关矩阵。绿色表示两个画面期间归一化轮廓面积度量之间的相关性较高,红色表示相关性较低。

C:每个画面的时间序列段的平均轮廓面积。两天内的平均值变化相似(G1P:蓝色;G2P:橙色)。

该研究展示了一个在真实社交环境中应用的全面框架。他们研发的系统在60名参与者观看现场音乐会和纪录片放映时进行了测试,解决了网络带宽、实时监控和共同坐标空间的凝视投射等挑战,实现了精确的时间同步和凝视投射。

研究引入并评估了新颖的分析指标和可视化,展示了系统在现实世界社交环境中的应用潜力,有助于理解协作行为、群体动态和社交互动,并推动创新交互工具的发展。

然而,他们也面临眼动追踪硬件选择和操作中的一些问题,这限制了技术的广泛应用。但是在未来,该项技术随着科技的优化,必将会扩展到不同的社交环境和硬件平台。

| 多人眼动追踪技术应用 | |

| 教育和学习环境中的学习效果 | 探索学生在课堂或学习环境中的眼动模式,以及与学习成效的关系。 |

| 驾驶员的注意力和行车安全 | 分析驾驶员在道路上的眼动活动,评估其与驾驶安全的关联。 |

| 体育比赛中的运动员和观众行为 | 研究运动员和观众在体育赛事中的眼动模式和注意力分配。 |

| 广告效果和消费者行为 | 评估消费者在观看广告时的眼动反应,研究广告对购买决策的影响。 |

| 医疗环境中的医疗实践和病人关注力 | 分析医护人员和病人在医疗环境中的眼动模式,以改善医疗服务和病人关注力。 |

| 市场调查和消费者行为研究 | 探索消费者在购物过程中的眼动行为,以了解市场偏好和购买决策过程。 |

| 交互式媒体和虚拟现实应用 | 优化虚拟现实和交互式媒体的用户界面和体验设计,以提升用户参与和沉浸感。 |

| 电影和电视节目中的观众反应 | 研究观众在观看电影和电视节目时的眼动模式和情感反应。 |

| 社交媒体平台上的用户行为分析 | 分析社交媒体用户在浏览、评论和分享内容时的眼动模式和互动方式。 |

| 音乐会或音乐节上的观众反应和互动行为 | 研究观众在音乐会或音乐节现场的眼动模式和参与方式。 |

| 工业生产线上的操作员视觉注意力与工作效率 | 评估工业生产线上操作员的眼动行为,以优化生产效率和质量控制。 |

| 交通控制中心中的运输协调与应急响应 | 分析交通控制中心调度员在管理交通流量和应对突发事件时的眼动模式。 |

| 虚拟现实环境中的用户体验和交互设计 | 优化虚拟现实应用的用户界面和交互体验,提升用户沉浸感和操作效率。 |

| 团队协作与项目管理 | 在办公室或会议室环境中,通过多人眼动追踪来研究团队成员在协作过程中的注意力分配和信息获取方式。 |

| 医疗与健康领域 | 在临床环境中,通过多人眼动追踪来研究医护人员在手术过程或病人诊断中的视觉焦点和注意力分配,以改善医疗服务的质量和效率。 |

| 心理学研究和行为分析 | 在实验室或现实生活中,通过多人眼动追踪来研究个体或群体在不同情境下的情绪反应和认知过程,以深入理解人类行为和社交互动的心理机制。 |